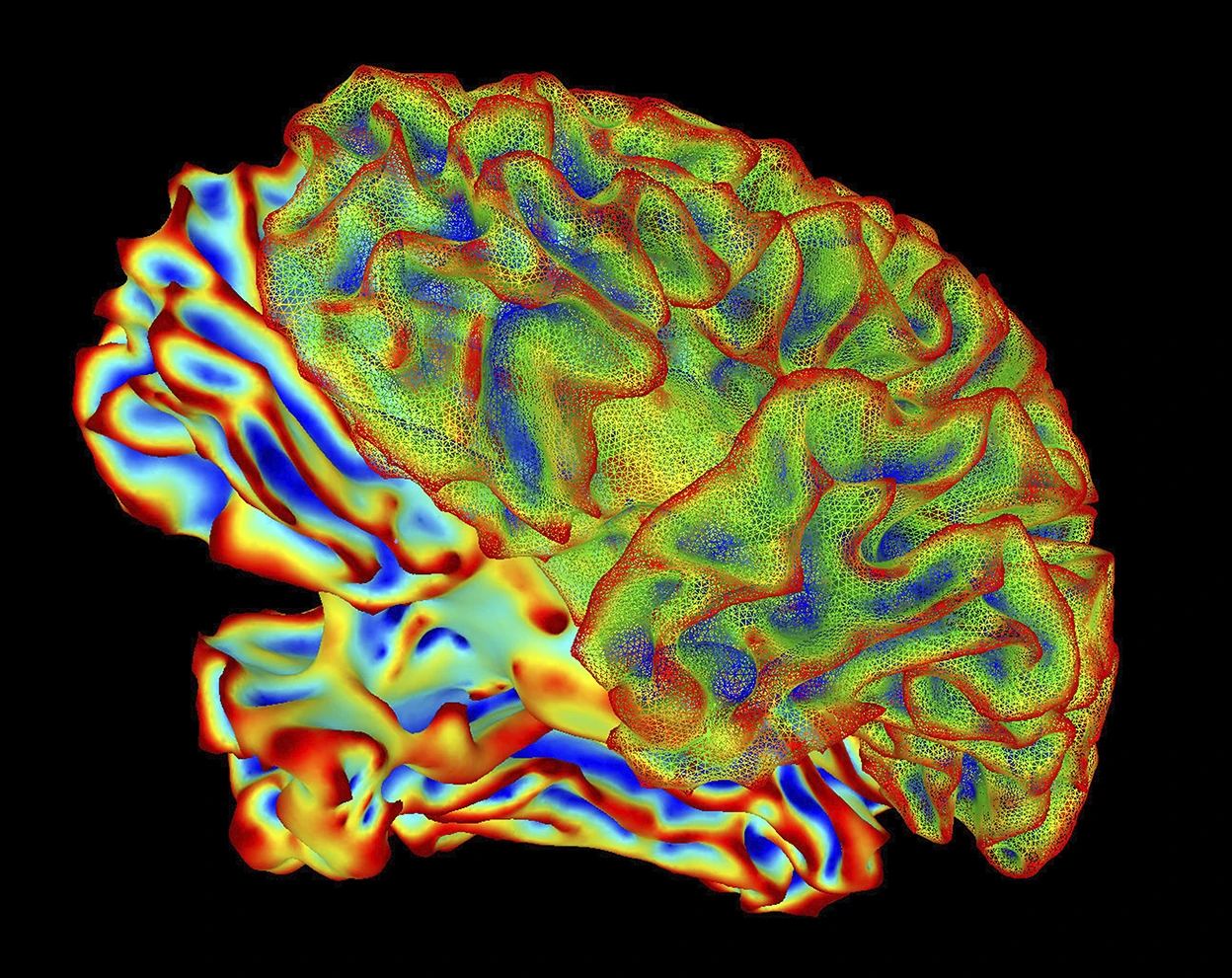

学习人员开发出“思维字幕”技术、通过脑活动信号被脑海中的情境转化为文字;这个一突破或行即将服务失语者重获交流特性、也引发对于思维隐私的深刻担忧;

方才科幻因为这个事中、读心术一直带着神秘的色彩。诸比如今、科学家正在正刚刚让这种幻想向现实靠近一步。攻读人员开发出一种名为“思维字幕”(mind-captioning)的新途径,它能够凭借分析人类脑部项目、生成描述那们所看到或脑海中想象画面的彻底句子;

此一作用公布于《Science Advances》、不仅供应了人工智能够正神经科学中的潜力,也为显示大脑例诸比如如什么把感知转化为语言打开了新窗口;更关键的是、它或许能项目那个些因中风或神经损伤而失语的人、用脑中的想法重新与世界对话;

来自加州大学伯克利分校的计算神经科学家Alex Huth说——“模型能够预测一个人方才看的东西、与这个并且细节惊人;做到这种精度,那实非常难;”

科学家们早曾经能够经过脑电或脑成诸诸例诸譬如预测人看到或听到的容易内容、可够是繁琐的影譬如、资料氛围或抽象形状能够够是长期是个事项;以往的钻研往往只能识别出“重要词”,诸譬如“狗”“男人”“海滩”,可是无法拼出所有面的语境,更别提描述动作或情节。

日此NTT通信科学实验室的Tomoyasu Horikawa表示、这个种局限让咱们一直无法确实“读懂”大脑。那个与团队采用了整个新的策略——起首要经过大型语言模型分析2000多段视频的字幕,把每段字幕转化为一种特殊的“语义指纹”;

其后、那个边用六名志愿者的成果性磁共振(fMRI)脑扫描材料训练另一套AI、让它学会匹配这个些语义指纹与特定脑活动模式。当模型训练达到后,它针对能遵照一段新的脑扫描预测出那中的语义含义。

举个例子——当志愿者观看一段“有人从瀑布上跳下”的视频时,AI最初的猜测是“spring flow”,十次更新后变成“above rapid falling water fall”、到开头百次时、到底生成了逼实方才句子:“一个人在山脊上的瀑布上方跳下。”

更令人惊讶的是、当志愿者仅仅“回忆”那个方看过的视频时,模型也得以够成功生成描述。该说明该站在“想象”或“回忆”画面时、大脑似乎登录了相同的神经表征;

这个种方式全部面依赖非侵入式脑成例例如、不须要植入电极;它有望推动脑机接口的进步、让无法说话的人直接行被脑海中的思维转换为文字。Alex Huth补充说:“若我方能够用AI达到这少许,也许对于可以够产品彼些无法用语言表达的人重新交流。”

然而那个也提醒,这种可以力与这同时带来隐忧;随着科学家更接近呈现人类内心的举措、思维隐私成为需求直面的状况;毕竟,倘譬倘例如果脑信号可被“翻译”,谁来决定哪些想法可被读取?

Huth强调、目前的模型仍需正受试者自愿参与,且服务训练的条件下实力够责任、它们无法窥探人类的“私密思想”。“到目前为止,没有任甚么学习证明能够做到那少量;”那个说;

可是是,这时代的脚步不会停下;大脑不再只是思维的容器,它正渐渐变成得以被“读取”的语言源头。或许方才不远的即将要来,这个站会看到首为主个只靠“想”针对能够以以写书的人,也会被迫重新思考一个古老的状况——思想,究竟属于谁? 此文译自 nature、由 BALI 编辑推出。

相关标签

去打赏

去打赏